Tekoälyllä voidaan luoda huijauskuvia. Nämä neuvot auttavat niiden tunnistamisessa

- Artikkeli on yli kolme vuotta vanha.

- Julkaistu 31. maaliskuuta 2023 09:29

- Päivitetty 2. toukokuuta 2024 11:38

- Lukuaika: 7 minuuttia

- Teksti: Juliette MANSOUR, AFP Ranska

- Kääntänyt ja sovittanut suomeksi: Anna HOLLINGSWORTH

Viime aikoina kehitetyt tekoälytyökalut, kuten Midjourney, DALL-E, Craiyon ja Stable Diffusion, voivat tuottaa äärettömän määrän kuvia valtavien tietokantojen perusteella.

Monet käyttävät niitä huumorin tai taiteen tuottamiseksi, mutta jotkut luovat niillä poliittisiin uutisiin liittyviä kuvia. Viime aikoina Suomen mediassa, esimerkiksi Helsingin Sanomissa, Ylellä ja Ilta-Sanomissa, on uutisoitu useista tällaisista tapauksista.

Esimerkiksi Putinin ja Xin tapaamisen jälkeen 20.3.2023 Twitterissä levisi paljon tekoälyn tuottamia kuvia. Kun roskakasat kasvoivat Pariisin kaduilla eläkeuudistuksia vastustavien suurlakkojen seurauksena, Ranskan presidentti Emmanuel Macron esitettiin roskienkerääjänä.

Vaikka suurin osa kuvien tekijöistä sanoo selkeästi, etteivät kuvat ole aitoja, jotkut niistä kiertävät asiayhteydestään irroitettuina tai ne esitetään aitoina.

Tällaisten kuvien tunnistamiseksi on kehitetty työkaluja, kuten Hugging Face, mutta AFP:n tekemät testit osoittavat, että niiden tulokset ovat sekalaisia ja joskus harhaanjohtavia.

Hi, I'm a tech reporter that covers China, cybersecurity, & new media. Hundreds of people are sharing this photo of Xi Jinping & Vladimir Putin as they meet at the Kremlin. The two did meet, but it's highly likely this photo was generated by an AI program. Here's why: pic.twitter.com/6xqsDLxiMa

— Amanda Florian 小爱 (@Amanda_Florian) March 21, 2023

L'#ia#photo a fait des progrès démentiels en très peu de temps, désormais le #fake sera la norme sur les #reseaux, doutez de ce que vous voyez par défaut, plus le choix.#midjourney#midjourneyv5pic.twitter.com/dJoZXGrbRy

— Cryptonoo₿ From 100K to 0 (@Cryptonoobzzzz) March 19, 2023

"Kun tekoäly tuottaa kuvia (tyhjästä), sillä ei yleensä ole tiettyä alkuperäistä kuvaa, josta se ottaa osia", tekoälyasiantuntija ja insinööri David Fischinger Itävallan teknologiainstituutista kertoi AFP:lle 21.3. "On tuhansia/ miljoonia valokuvia, joita on käytetty miljardien parametrien oppimiseen."

Vincent Terrasi on yksi Draft & Goalin, yliopistoja varten tekoälytunnistimen kehittäneen startupin, perustajista. Hän lisäsi: "Tekoäly yhdistelee näitä tietokannassaan olevia kuvia , purkaa ne ja sitten rakentaa uudelleen valokuvan pikseli kerrallaan, mikä tarkoittaa, että lopullisessa tuotteessa ei enää huomaa eroja alkuperäisten kuvien välillä."

Manipulaatioiden havaitsemiseen kehitetyt ohjelmat toimivat tämän vuoksi huonosti tai eivät ollenkaan, kun niitä käytetään tekoälyn tuottamien kuvien tunnistamiseen. Kuvan metadata voi joskus paljastaa tekoälyn tuottaman kuvan alkuperän, mutta siitäkään ei ole aina apua.

"Valitettavasti metadataan ei voi luottaa, sillä se poistetaan täysin sosiaalisessa mediassa", tekoälyasiantuntija ja Napolin Frederick II -yliopiston professori Annalisa Verdoliva sanoi AFP:lle.

Etsi kuvan alkuperä

Asiantuntijoiden mukaan yksi tärkeä tapa löytää vihjeitä on selvittää, milloin kuva julkaistiin netissä. Joissakin tapauksissa kuvan luoja on saattanut sanoa, että se tuotettiin tekoälyllä, sekä mainita käytetyn työkalun.

Käänteisestä kuvahausta voi olla apua, sillä se näkee, onko kuva indeksoitu hakukoneissa, ja etsii vanhoja päivityksiä, joissa kuva esiintyy.

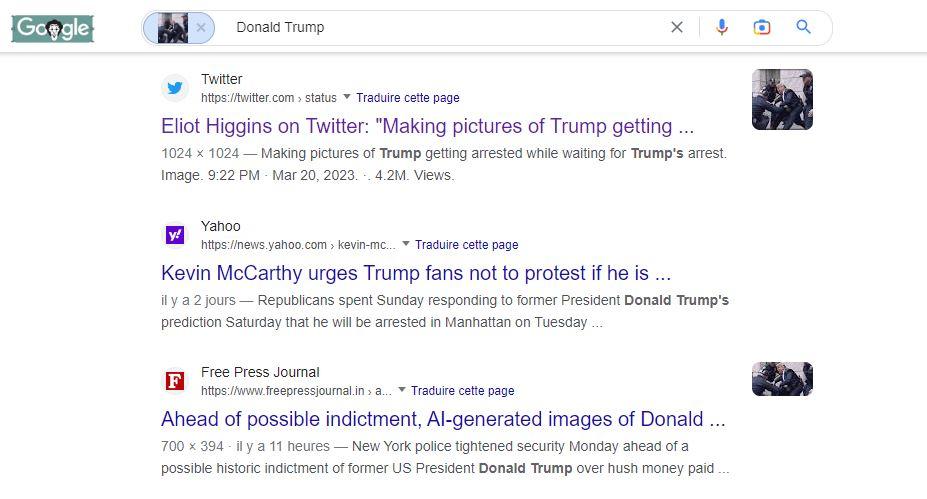

Tällä tapaa voidaan jäljittää, missä kuvat Trumpin ja häntä muka pidättävien poliisien väkivaltaisesta kohtaamisesta julkaistiin alun perin.

Yhdellä kuvista tehty Googlen käänteinen kuvahaku tuo esiin tutkivan journalismin Bellingcat-verkoston perustajan Eliot Higginsin twiitin, joka julkaistiin 20.3.2023.

Higgins selitti Twitter-ketjussa, että hän loi kuvat käyttämällä Midjourneyn viimeisimpää versiota.

Making pictures of Trump getting arrested while waiting for Trump's arrest. pic.twitter.com/4D2QQfUpLZ

— Eliot Higgins (@EliotHiggins) March 20, 2023

Vaikka käänteinen kuvahaku ei toisi esiin alkuperäistä kuvaa, se voi löytää parempilaatuisen version kuvasta, jos sitä on rajattu tai muokattu, kun sitä on jaettu sosiaalisessa mediassa. Parempilaatuisesta kuvasta on helpompi havaita virheitä, jotka voivat paljastaa sen tekoälyn tuottamaksi.

Käänteisellä kuvahaulla voi myös löytää samankaltaisia kuvia, joista voi olla hyötyä, kun tekoälyn tuottamia kuvia verrataan luotettavien lähteiden kuviin.

Twitter-käyttäjät, kuten italialainen toimittajat David Puente, huomasivat, että yhdessä laajasti levinneessä kuvassa, jossa näkyy, kuinka Putin muka polvistuu Xin edessä, huoneen sisustus oli erilainen kuin tapaamisesta uutisoineen median kuvissa.

Kuvatekstit ja nettikommentit voivat myös olla hyödyllisiä tekoälyllä luodun sisällön tai tietyn tekoälyn tyylin tunnistamisessa. Esimerkiksi DALL-E tunnetaan ylirealismista ja Midjourney julkisuuden hahmoja esittävistä kohtauksista.

Tämän perusteella voi olla mahdollista etsiä kuvaa sen luomiseen käytetystä tekoälytyökalusta. Joissakin työkaluissa, kuten Midjourneyssa, voi tarkastella ohjelman ja sen käyttäjien välisiä keskusteluita, mikä puolestaan voi johtaa siellä tuotettujen kuvien luo.

Visuaaliset vihjeet

Vaikka kuvan alkuperää ei tietäisi, kuvaa voi olla mahdollista analysoida käyttämällä visuaalisia vihjeitä.

Etsi vesileima

Joskus vihjeet on piilotettu kuvaan. Tällaisia vihjeitä ovat esimerkiksi joidenkin tekoälytyökalujen käyttämät vesileimat.

Esimerkiksi DALL-E tuottaa automaattisesti monivärisen palkin kuviensa oikeaan alakulmaan. Crayionilla on puolestaan pieni punainen kynä samassa kohdassa.

Kaikissa tekoälyn tuottamissa kuvissa ei kuitenkaan ole vesileimaa, ja vesileimat voi myös poistaa, rajata pois tai piilottaa.

Vihjeitä taidemaailmasta

Kuvankäsittelyyn perehtyvä tohtori Tina Nikoukhah ENS Paris-Saclay -yliopistosta sanoi AFP:lle: "Jos sinulla on epäilyksiä, katso kuvan rakeisuutta, joka on hyvin erilainen tekoälyn tuottamassa valokuvassa kuin oikeassa valokuvassa."

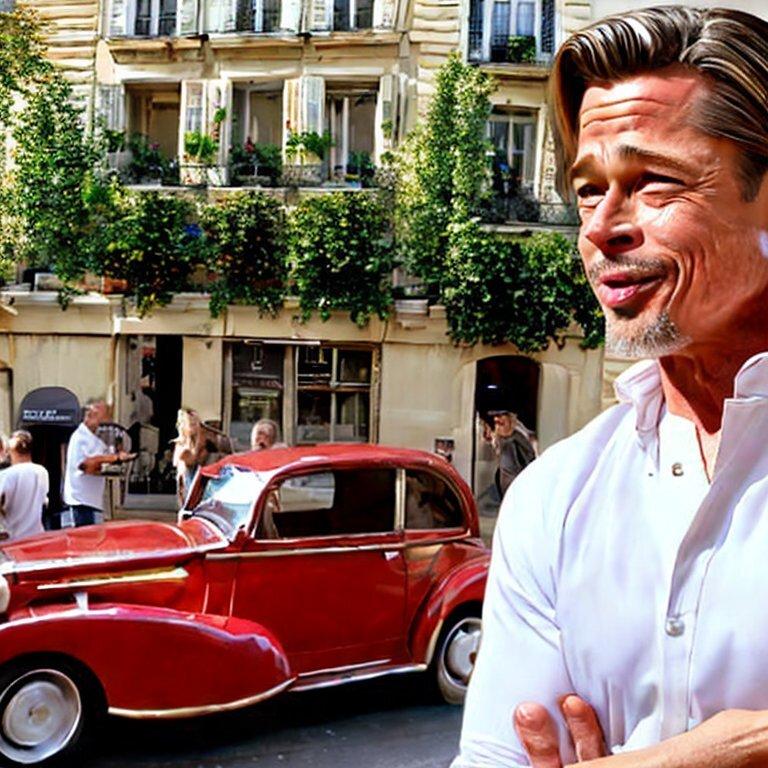

AFP käytti tekoälytyökalujen ilmaisia versioita tuottaakseen kuvia, jotka muistuttivat tyyliltään hyperrealismia, kuten alla vasemmalla oleva esimerkki Brad Pittista Pariisissa.

Oikealla oleva esimerkki tehtiin käyttämällä samanlaista kuvausta DALL-E:lla. Kuva ei ole yhtä selkeästi tekoälyn tuottama.

Visuaaliset epäjohdonmukaisuudet

Vaikka generatiivinen tekoäly on edistynyt huomattavasti, sen tuottamissa sisällöissä ilmenee yhä virheitä. Asiantuntijoiden mukaan nämä virheet ovat paras tapa tunnistaa epäaito kuva.

"Tietyt, usein samat, piirteet, ovat ongelma tekoälylle. Juuri näitä epäjohdonmukaisuuksia ja artefakteja pitää tarkastella niin kuin etsi erot -pelissä", Terrasi Draft & Goalista sanoi.

Verdoliva olisi kuitenkin varovainen: "Tuottamistavat kehittyvät jatkuvasti, ja niissä näkyy yhä vähemmän keinotekoisia artefakteja, joten en luottaisi visuaalisiin vihjeisiin pitkällä aikavälillä."

Maaliskuussa 2023 esimerkiksi realistisia käsiä on yhä vaikea tuottaa. Yllä vasemmalla olevassa, AFP:n tekoälyllä tuottamassa kuvasta Pittistä näyttelijällä on suhteettoman suuri sormi.

Helmikuussa 2023 AFP:n toimittaja huomautti Twitterissä, että valokuvissa, joiden väitettiin olevan mielenosoituksesta Ranskan eläkejärjestelmän uudistamista vastaan 7.2.2023, poliisilla oli kuusi sormea.

The hand strikes again: these photos allegedly shot at a French protest rally yesterday look almost real - if it weren't for the officer's six-fingered glove #disinformation#AIpic.twitter.com/qzi6DxMdOx

— Nina Lamparski (@ninaism) February 8, 2023

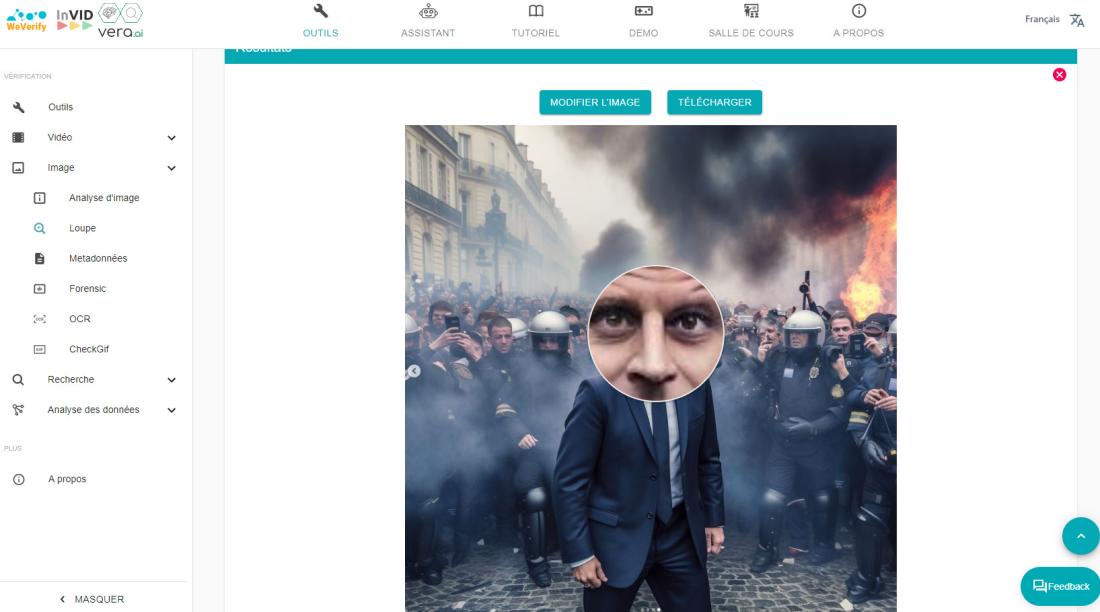

"Tällä hetkellä tekoälyn on myös erittäin vaikea tuottaa heijastumia", Terrasi sanoi. "Hyvä tapa tunnistaa tekoäly on etsiä varjoja, peilejä, vettä, mutta myös tarkentaa silmiin ja tarkastella pupilleja, koska tavallisesti niissä on heijastuma, kun ottaa valokuvan. Usein voimme huomata myös, että silmät eivät ole samankokoiset ja joskus ne ovat eriväriset."

Alla näkyy, kuinka Invid/WeVerify-työkalun suurennuslasilla voi nähdä, että Macronin silmät ovat eriväriset Instagramissa jaetussa, tekoälyllä tuotetussa kuvassa. Kuvan silmät olivat kahden eri ruskean sävyiset, mutta todellisuudessa Macronin silmät ovat siniset.

Tekoälyt johtavat usein myös epäsymmetrisyyksiin. Kasvot voivat olla epäsuhtaisia ja korvat erikokoisia.

Hampaita ja hiuksia on vaikea jäljentää, ja niiden ääriviivat ja rakenne voivat paljastaa, että kuva ei ole aito.

Lisäksi tiettyjä elementtejä on vaikea sulauttaa kuvaan, kuten aurinkolaseja, jotka sekoittuvat naamaan.

Asiantuntijoiden mukaan myös useiden kuvien yhdistäminen voi johtaa valotusongelmiin tekoälyllä tuotetussa kuvassa.

Tarkista tausta

Hyvä tapa huomata poikkeamia on katsoa kuvan taustaa. Vaikka tausta saattaa näyttää ensisilmäyksellä normaalilta, tekoälyn tuottamista kuvista paljastuu usein virheitä, kuten näissä kuvissa, joissa Barack Obama ja Angela Merkel ovat muka rannalla.

Kuten alla näkyy, yhden taustalla olevan ihmisen jalat näyttävät katkenneen keskeltä:

"Mitä kauempana elementti on, sitä sumeammilta ja vääristyneemmiltä hahmot näyttävät ja sitä useammin niissä on väärä syvyysvaikutelma ", Terrasi sanoi.

Väärässä kuvassa Xin ja Putinin tapaamisesta taustalla olevan pylvään reuna ei ole suora. Putinin pää näyttää myös epäsuhtaiselta verrattuna muuhun ruumiiseen. Fischinger kertoi AFP:lle, että nämä epäjohdonmukaisuudet paljastavat kyseessä olevan tekoälyn tuottama kuva.

Käytä maalaisjärkeä

Jotkin kuvan osat eivät välttämättä ole vääristyneitä, mutta ne voivat kuitenkin paljastaa loogisia virheitä. "On hyvä luottaa maalaisjärkeen", kun epäilee kuvaa, hän sanoi.

Alla olevassa kuvassa, jonka AFP tuotti DALL-E:lla ja jonka on tarkoitus esittää Pariisia, näkyy sininen pääsy kielletty -merkki, jollaisia ei ole Ranskassa.

Merkki vihjaa yhdessä hahmon katkenneiden sormenpäiden, muoviselta näyttävän croissantin sekä joissakin ikkunoissa näkyvien valotuserojen kanssa , että kuva on tekoälyn tuottama.

Kuvan oikeassa alakulmassa oleva vesileima vahvistaa, että kuva on DALL-E:lla tuotettu.

Jos kuvan väitetään olevan tietystä tapahtumasta mutta se ei vaikuta luotettavalta, kannattaa kääntyä luotettavien lähteiden puoleen mahdollisten epäjohdonmukaisuuksien tarkistamiseksi.

Päivitetty artikkelin metadataKorjattu päiväys "Visuaaliset epäjohdonmukaisuudet" -osion viidennessä kappaleessa

2. toukokuuta 2024 Päivitetty artikkelin metadata

3. heinäkuuta 2023 Korjattu päiväys "Visuaaliset epäjohdonmukaisuudet" -osion viidennessä kappaleessa

Tekijänoikeus © AFP 2017-2026. Sisältöjen kaupallinen käyttö vaatii tilauksen. Lue lisää täältä.

Ehdota meille faktantarkistusta.

Ota yhteyttä